Le contenu dupliqué a longtemps été une pratique courante sur internet. Aujourd’hui, vivement traqué par les robots de Google, le duplicate content représente un risque majeur pour le référencement.

Dans la première décennie de ce siècle, je me souviens avoir trouvé sur un forum le texte d’un contributeur qui racontait la naissance d’une chanson et de la progression de sa popularité, au point de devenir un fameux chant de stade.

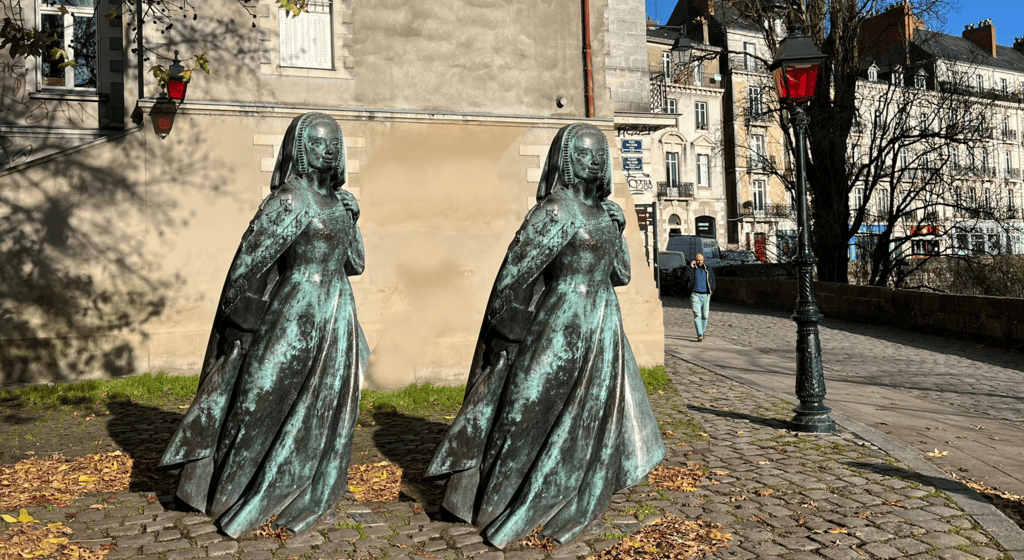

L’art du copier-coller

Ce n’est pas le contenu du texte à proprement parler qui m’interpellait, mais le style d’écriture, la tournure des phrases, les mots choisis… Mais oui, ce texte, c’est moi qui l’avait écrit ! Et je le retrouvais là, copié-collé sur un forum sans même en avoir été informé. Le forumiste sans scrupule n’avait cité ni l’auteur ni le site dans lequel il avait découvert ce (merveilleux) texte.

Dans les posts suivants, je lisais non sans fulminer les félicitations des autres contributeurs (félicitations que finalement j’aurais dû prendre à mon compte), jusqu’à ce que je tombe sur un nouveau post de mon plagiaire qui rédige, avec ses propres mots cette fois, quelque chose comme : “Merci les copains. Oui, j’avais deux trois heures à occuper, j’ai fait quelques recherches sur cette chanson, et puis voilà, j’ai trouvé sympa de vous partager mon travail…”.

Tu parles Charles ! Ça ne t’a pris que trente secondes : Contrôle C, Contrôle V !

La chasse aux copieurs

Le contenu dupliqué (ou duplicate content pour faire américain) a longtemps été la grande plaie du web d’avant le 2.0. Il était fréquent de retrouver du texte copié-collé d’un site à l’autre, ce qui était très frustrant pour l’auteur mais aussi pour l’internaute un peu fatigué de retrouver en plusieurs endroits un contenu similaire sans une once de valeur ajoutée.

Très vite, les autres moteurs de recherches ont décidé d’attaquer ces sites qui proposent le même contenu que le site voisin. Le plus grand d’entre eux, Google – gloire à lui – a développé des algorithmes de plus en plus sophistiqués pour détecter et sanctionner cette pratique.

L’algorithme Panda, lancé en 2011, a constitué la première arme majeure dans cette lutte. Depuis, les algorithmes n’ont cessé de s’améliorer sur ce plan, notamment avec le déploiement du Helpful Content Update entre 2022 et 2024, qui favorise davantage le contenu original et de qualité.

Original et copie

De nombreux sites coupables de duplicate content (ou contenu dupliqué pour rester français) se retrouvent ainsi déclassés. Le problème de cette répression est que la police googlienne n’a pas toujours bien fait la différence entre l’auteur originel et le plagiaire. On peut donc retrouver sa page déclassée alors que le texte provient de notre inspiration, notre talent, notre sang, nos tripes, du moins de notre équipe rédactionnelle.

Il est donc devenu important de ne pas reproduire sur son site du contenu externe, mais aussi de vérifier régulièrement si un concurrent n’a pas reproduit notre prose sur ses propres supports.

Aujourd’hui, les moteurs de recherche parviennent mieux à identifier l’auteur original et à pénaliser les copieurs. Cependant, le problème du duplicate content n’a pas disparu pour autant. Les scrapers automatiques continuent de récupérer massivement du contenu, et certains sites peu scrupuleux persistent dans leurs pratiques de plagiat pour gagner du temps et de l’argent.

Le duplicate content interne représente également un enjeu souvent négligé. Lorsqu’un même site présente un contenu similaire sur plusieurs URLs différentes, cela peut nuire à son référencement sans qu’il y ait intention malveillante. Les flux RSS, la syndication de contenu et les reprises légitimes peuvent également créer du duplicate involontaire qu’il convient de surveiller.

Quand l’IA vient semer le doute

L’émergence de l’intelligence artificielle a introduit une nouvelle dimension à cette problématique. Avec des outils comme ChatGPT et autres générateurs de texte, on assiste à la prolifération d’un contenu certes unique techniquement, mais souvent paraphrasé et manquant d’originalité réelle. Google travaille activement à détecter ce contenu généré automatiquement sans valeur ajoutée, élargissant ainsi la définition même du duplicate content.

Pour se protéger efficacement, plusieurs outils restent disponibles. Kill Duplicate, Copyfight, Duplichecker et CopyScape demeurent des références pour vérifier l’unicité d’un texte. Mais le plus simple à utiliser est largement plus connu. Vous copiez une partie du texte, deux ou trois phrases assez longues et qui se suivent et vous le collez dans la barre de recherche Google, en l’entourant de guillemets. Rapidement celui-ci trouvera l’occurrence équivalente. Pourquoi chercher plus loin ?

La vigilance reste donc primordiale. Non seulement ce n’est pas bien de copier du contenu externe, mais il faut en outre surveiller régulièrement que personne ne s’approprie son travail. Il faut également savoir vérifier l’unicité du contenu externalisé et celui généré par IA. On n’est pas à l’abri de trouver du duplicate content dans son propre site.